三言科技消息,9月6日,百川智能召开主题为“百川汇海,开源共赢”的大模型发布会。会上,百川智能宣布正式开源微调后的Baichuan 2-7B、Baichuan 2-13B、Baichuan 2-13B-Chat与其4bit量化版本,并且均为免费可商用。

百川智能此次还开源了模型训练的Check Point,并宣布将发布Baichuan 2技术报告,详细介绍Baichuan 2的训练细节,帮助大模型学术机构、开发者和企业用户更深入的了解其训练过程,更好地推动大模型学术研究和社区的技术发展。

文理兼备性能优异

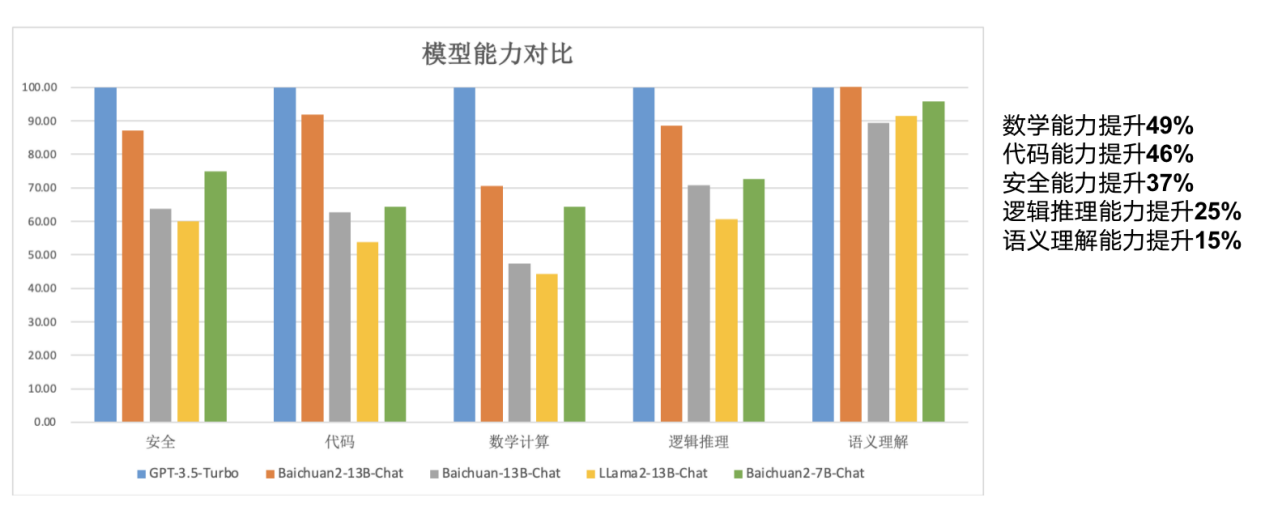

Baichuan 2-7B-Base和Baichuan 2-13B-Base,均基于2.6万亿高质量多语言数据进行训练,在保留了上一代开源模型的生成与创作能力,多轮对话能力以及部署门槛较低等众多特性的基础上,两个模型在数学、代码、安全、逻辑推理、语义理解等能力有显著提升。其中Baichuan 2-13B-Base相比上一代13B模型,数学能力提升49%,代码能力提升46%,安全能力提升37%,逻辑推理能力提升25%,语义理解能力提升15%。

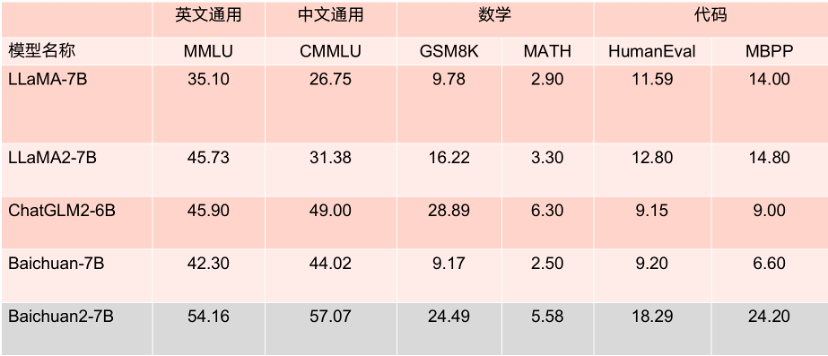

值得一提的是,根据MMLU等多个权威英文评估基准评分Baichuan2-7B以70亿的参数在英文主流任务上与130亿参数量的LLaMA2持平。

7B参数模型的Benchmark成绩

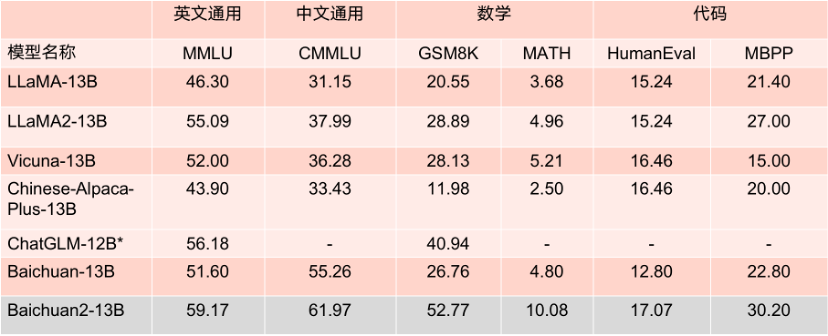

13B参数模型的Benchmark成绩

Baichuan2-7B和Baichuan2-13B不仅对学术研究完全开放,开发者也仅需邮件申请获得官方商用许可后,即可以免费商用。

全程开源模型训练Check Point,助力学术研究

大模型训练包含海量高质量数据获取、大规模训练集群稳定训练、模型算法调优等多个环节。每个环节都需要大量人才、算力等资源的投入,从零到一完整训练一个模型的高昂成本,阻碍了学术界对大模型训练的深入研究。

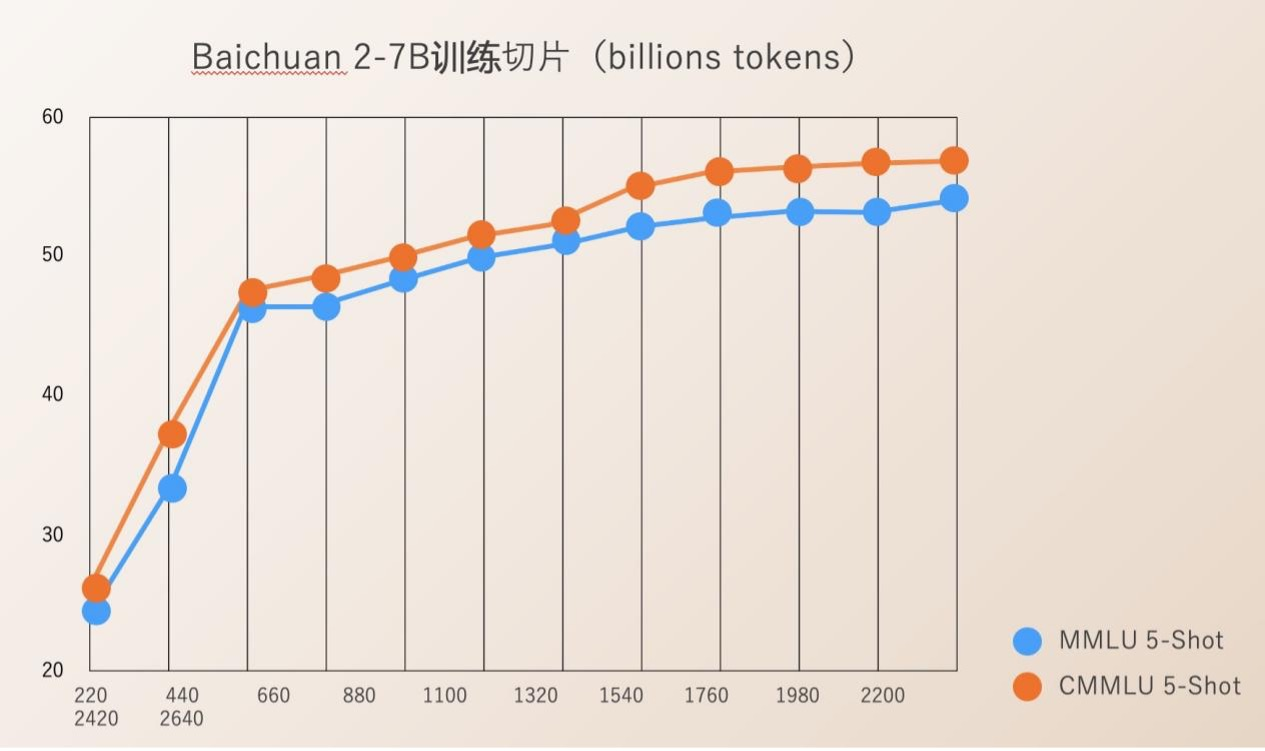

百川智能本次开源了模型训练从220B到2640B全过程的Check Ponit。这对于科研机构研究大模型训练过程、模型继续训练和模型的价值观对齐等极具价值,将极大推动国内大模型的科研进展。

技术报告揭示训练细节,繁荣开源生态

当前大部分开源模型在开源过程中只是对外公开自身的模型权重,很少提及训练细节,企业、研究机构、开发者们只能在开源模型的基础上做有限的微调,很难进行深入研究。

百川智能在发布会上宣布,公开Baichuan 2的技术报告。技术报告将详细介绍Baichuan 2 训练的全过程,包括数据处理、模型结构优化、Scaling law、过程指标等。

在今年创立的大模型公司中,百川智能通过《生成式人工智能服务管理暂行办法》备案,可以正式面向公众提供服务的企业。此次开源的两款Baichuan 2大模型,得到了上下游企业的积极响应,腾讯云、阿里云、火山方舟、华为、联发科等众多企业均参加了本次发布会并与百川智能达成了合作。

未来,百川智能将在开源大模型领域持续深耕,将更多的技术能力、前沿创新开放出来,与更多的合作伙伴们共同助力中国大模型生态发展。